Facciamo un gioco: mettete da parte per un momento la politica tradizionale (anche per distrarvi un po’ dal senso di desolazione). Al suo posto, immaginate un sistema dove le decisioni vengono prese da algoritmi avanzati, basandosi su dati oggettivi anziché su opinioni personali. Governi artificiali? Già. Suonano davvero, davvero strani. Ma non sono più solo un’ipotesi così di frontiera: la tecnologia sta aprendo scenari che meritano una seria riflessione.

L’alba di una nuova governance

Con l’avvento delle smart cities e dei sistemi basati su blockchain, il concetto di governo artificiale sta emergendo come potenziale evoluzione della democrazia. Mi colpisce come questa idea riecheggi la visione di Platone di un governo guidato dalla “ragione pura”, anche se in una forma che il filosofo greco non avrebbe mai potuto immaginare (e forse neanche noi, allo stato attuale dello sviluppo della cosiddetta intelligenza artificiale).

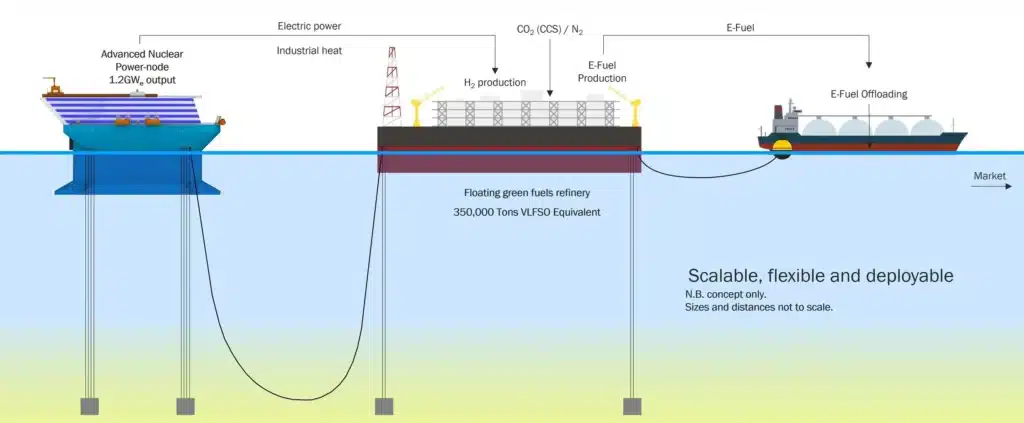

Ad ogni modo, assumendo per ipotesi che questa “governance elettronica” ci fosse e fosse al suo massimo splendore, quali sarebbero i suoi lati positivi e negativi? Iniziamo dalle buone note: il vantaggio più evidente dei governi artificiali è la capacità di processare enormi quantità di dati per prendere decisioni oggettive. Nick Bostrom, filosofo dell’Università di Oxford, suggerisce che un sistema di intelligenza artificiale potrebbe ottimizzare la distribuzione delle risorse pubbliche con una precisione impossibile per gli esseri umani, anche modificando i parametri e i capitoli di spesa in tempo reale o quasi reale.

L’eliminazione del pregiudizio umano dal processo decisionale sarebbe il secondo, potenziale beneficio. Come teorizzato da Lawrence Lessig, l’architettura del codice potrebbe garantire una forma di giustizia più equa e trasparente. I sistemi di IA non sarebbero influenzati da emozioni, pregiudizi o interessi personali. Che favola! O no? Frenate.

Il prezzo dell’automazione

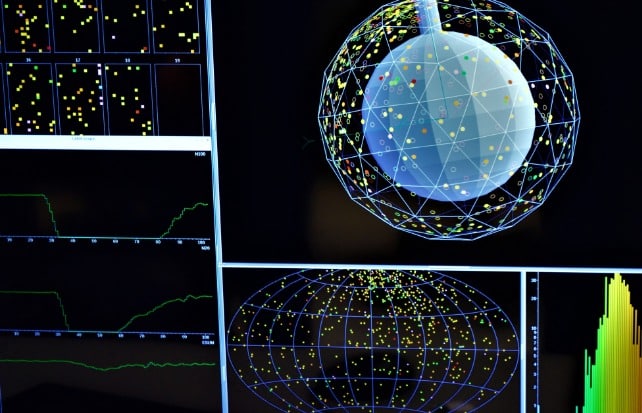

Shoshana Zuboff, sociologa e saggista statunitense, ci mette in guardia contro i rischi del “capitalismo della sorveglianza”. I governi artificiali richiederebbero un monitoraggio costante dei cittadini per funzionare efficacemente. Mi preoccupa particolarmente questa potenziale erosione della privacy individuale. Chi programma gli algoritmi? Questa domanda, sollevata da Yuval Noah Harari, evidenzia un paradosso fondamentale: anche i sistemi più oggettivi devono essere inizialmente programmati da esseri umani, con i loro valori e pregiudizi. La neutralità assoluta potrebbe essere un’illusione.

Il filosofo James Moor solleva un punto cruciale: come si può garantire la responsabilità in un sistema automatizzato? Se un algoritmo prende una decisione sbagliata, chi ne risponde? La catena di responsabilità diventa nebulosa quando le decisioni sono delegate alle macchine. Martha Nussbaum, infine, ci ricorda l’importanza delle emozioni nel ragionamento morale. Un governo puramente artificiale potrebbe mancare di quella comprensione empatica necessaria per decisioni che impattano profondamente la vita delle persone. Allora buttiamo via tutto! O no? Frenate.

Governi artificiali: il futuro della democrazia è un modello ibrido?

La soluzione potrebbe risiedere in quello che Don Ihde chiama “tecnologia post-fenomenologica”: un sistema che integra l’efficienza algoritmica con la supervisione umana. Non un governo completamente artificiale, dunque, ma una collaborazione tra intelligenza umana e artificiale. Jürgen Habermas enfatizza l’importanza del dialogo nella democrazia. Come potrebbe un governo artificiale facilitare, piuttosto che sostituire, questo processo deliberativo? La tecnologia dovrebbe amplificare, non sopprimere, la voce dei cittadini.

La prospettiva dei governi artificiali ci costringe a riconsiderare il significato stesso di democrazia nell’era digitale. Non si tratta solo di efficienza amministrativa, ma di ridefinire il contratto sociale per l’età dell’intelligenza artificiale. Come sosteneva Hannah Arendt, il potere politico deriva dal consenso, non dalla coercizione. Qualsiasi sistema di governo artificiale dovrà guadagnarsi la fiducia dei cittadini attraverso la trasparenza, l’accountability e il rispetto dei diritti fondamentali. Il futuro della governance potrebbe non essere né completamente umano né completamente artificiale, ma una sintesi che prende il meglio da entrambi i mondi.

Solo una cosa: se si mette male, con chi ce la prendiamo?

L’articolo Governi artificiali: pro e contro degli algoritmi al potere è tratto da Futuro Prossimo.

Società, Governance, intelligenza artificiale